W sieci pojawia się coraz więcej filmów stworzonych przy pomocy sztucznej inteligencji, które okłamują internautów. Portal NewsGuard zapytał o to rzecznika OpenAI, Oscara Hainesa.

Na Tik Toku i w Telegramie pojawia się ostatnio sporo filmów stworzone za pomocą Sora 2 (narzędzie do tworzenia filmów OpenAI), które przekazują kłamliwe informacje o ukraińskiej armii.

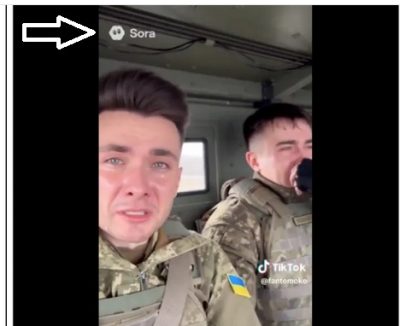

Niedawno pisaliśmy o filmie przedstawiającym „płaczącego ukraińskiego żołnierza”, który nie chce iść na front:

Teraz (19.11.2025) ukraińskie Centrum Przeciwdziałania Dezinformacji poinformowało o filmie, na którym „ukraińscy żołnierze” „zabijają” swoich rannych towarzyszy zamiast udzielić im pomocy.

„W rzeczywistości jest to kolejna inscenizacja rosyjskich propagandystów. Wideo zostało celowo nakręcone tak, aby niemożliwe było rozpoznanie jakichkolwiek szczegółów: nie widać twarzy, brakuje charakterystycznych obiektów czy cech terenu. Całość została nagrana w ciemności lub w zamkniętym pomieszczeniu, gdzie łatwo jest ukryć wszystko i w pełni kontrolować obraz” – wyjaśnia Centrum.

Kilka dni wcześniej o innym takim filmie napisał portal NewsGuard. „Wygenerowane przez AI wideo, stworzone za pomocą Sora 2 od OpenAI, rzekomo pokazuje dwóch ukraińskich żołnierzy płaczących i błagających, by nie wysyłano ich na front.” – pisze Alice Lee.

W listopadzie 2025 roku NewsGuard zidentyfikował siedem wygenerowanych przez AI filmów przedstawianych jako nagrania z linii frontu w Pokrowsku, który przed rosyjskim agresorem broni ukraińska armia. Filmy, które uzyskały miliony wyświetleń na platformach X, TikTok, Facebook i Telegram, pokazywały sceny masowego poddawania się ukraińskich żołnierzy i błagania Rosji o przebaczenie.

„Filmy zawierają liczne nieścisłości, w tym ekwipunek i mundury, które nie pasują do tych używanych przez Siły Zbrojne Ukrainy, nienaturalne twarze oraz błędną wymowę nazw ukraińskich miast. NewsGuard przetestował filmy za pomocą detektora AI Hive, który ze 100-procentową pewnością ustalił, że wszystkie siedem zostało stworzone za pomocą Sora 2.” – pisze wspomniana autorka.

Wygenerowane przez AI filmy były udostępniane przez anonimowe konta, które NewsGuard regularnie identyfikuje jako rozpowszechniające prokremlowską propagandę.

NewsGuard 12 listopada 2025 zapytał o to Oscara Hainesa, rzecznik OpenAI. Ten miał udzielić odpowiedzi następnego dnia, jednak nie odpowiedział na późniejsze zapytania.

Kremlin Propagandists Weaponize OpenAI’s Video Generator

COMMENTS